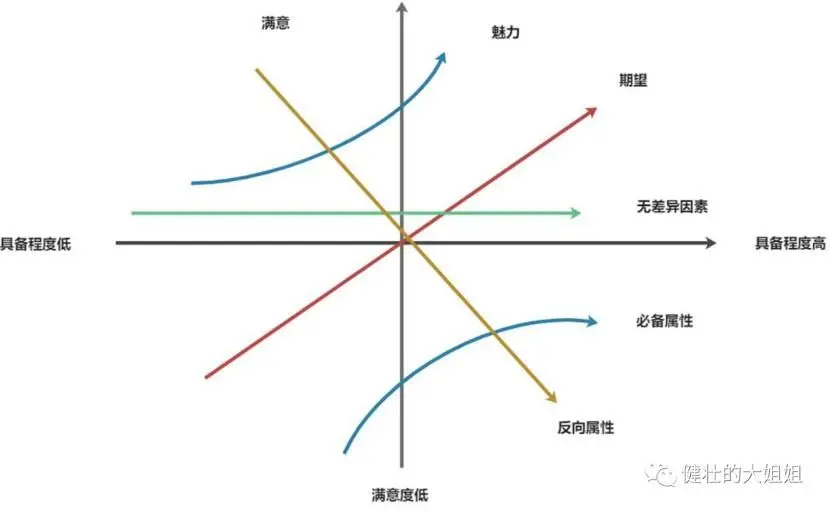

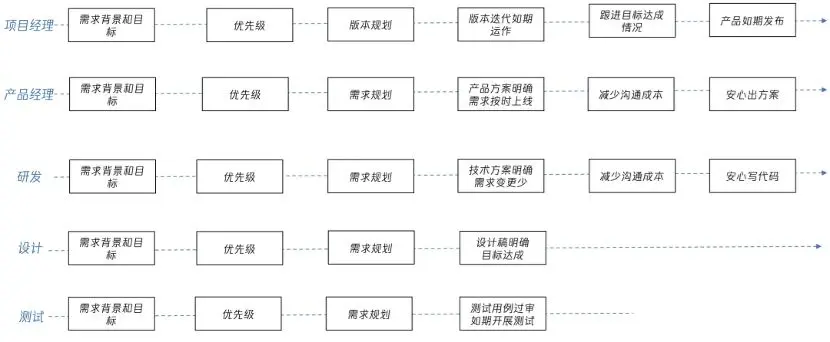

在团队工作中,产品经理需要身兼多职、兼顾多方意见。而产品版本迭代管理往往需要牵扯项目的多方面。那么,当产品经理着手版本迭代管理工作时,应当如何协调团队工作、做好过程控制、进而凝聚团队力量? 怎么规划产品的阶段性里程碑?从团队KPI入手:今年团队的考核目标是什么,是产品收入?用户活跃度?标杆案例数?项目的复制情况?制定个人OKR:基于团队的目标,落实到个人所负责的产品目标,去看在该目标下你要输出的关键结果是什么。KANO模型:这是东京理工大学教授狩野纪昭(Noriaki Kano)发明的对用户需求分类和优先排序的工具,需求分五类:基本型需求、期望型需求、兴奋型需求、无差异型需求、反向型需求。 基本型需求(必备型需求):客户认为必须有,没有的话这个功能就不具有交付意义的需求。期望型需求:客户期望你可以实现的需求,一旦你实现了,客户满意度会显著提升,你提供的产品超出客户期望越多,客户就越满意。兴奋型需求(魅力型需求):客户既不会过分期望,又不会明显不满的需求,即,有更好,没有也能接受。 无差异型需求:这类需求对客户没有影响,有或没有都无所谓。反向型需求:该需求会引起大部分人的强烈不满,你实现该需求反而会降低客户的满意度。 实际规划产品蓝图时,可以从以下两方面去考虑:一方面根据团队OKR划定产品方向,圈定几个需要冲刺的功能模块,分月度、季度去迭代功能、做项目验证,再炮制到其他项目中落地;另一方面摆正心态,正视客户反馈的需求,全力以赴满足基本型需求,重视产品义务范畴内的事项,确保在市场竞争中不丢分。同时,尽力去满足客户的期望型需求,提供大多数客户关注的额外服务和产品,引导客户的决策链对本产品有更多的倾向性;最后才是争取实现客户的兴奋型需求,提高客户用户的粘性和复购率。 记住,排优先级时,不可只关注客户需求而忽视了去建设能满足更多客户的核心优势。在明确版本需求和需求的优先级后,我们再来看下如何调动资源投入到版本迭代。

基本型需求(必备型需求):客户认为必须有,没有的话这个功能就不具有交付意义的需求。期望型需求:客户期望你可以实现的需求,一旦你实现了,客户满意度会显著提升,你提供的产品超出客户期望越多,客户就越满意。兴奋型需求(魅力型需求):客户既不会过分期望,又不会明显不满的需求,即,有更好,没有也能接受。 无差异型需求:这类需求对客户没有影响,有或没有都无所谓。反向型需求:该需求会引起大部分人的强烈不满,你实现该需求反而会降低客户的满意度。 实际规划产品蓝图时,可以从以下两方面去考虑:一方面根据团队OKR划定产品方向,圈定几个需要冲刺的功能模块,分月度、季度去迭代功能、做项目验证,再炮制到其他项目中落地;另一方面摆正心态,正视客户反馈的需求,全力以赴满足基本型需求,重视产品义务范畴内的事项,确保在市场竞争中不丢分。同时,尽力去满足客户的期望型需求,提供大多数客户关注的额外服务和产品,引导客户的决策链对本产品有更多的倾向性;最后才是争取实现客户的兴奋型需求,提高客户用户的粘性和复购率。 记住,排优先级时,不可只关注客户需求而忽视了去建设能满足更多客户的核心优势。在明确版本需求和需求的优先级后,我们再来看下如何调动资源投入到版本迭代。

乖女锁不住 发布的最新帖子

-

做好版本迭代管理发布在 极客生涯

-

#用EXCEL如何构建RFM会员价值模型发布在 极客生涯

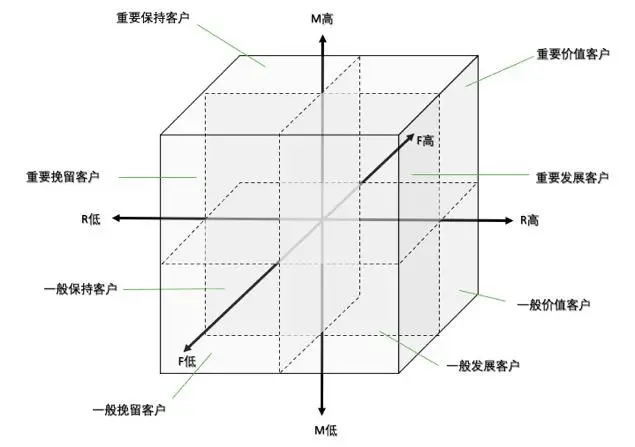

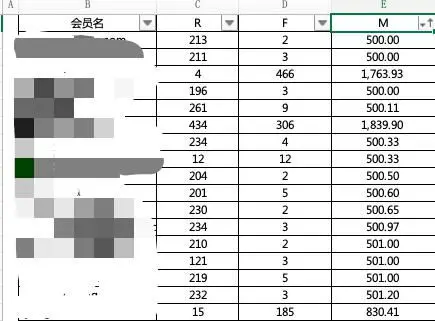

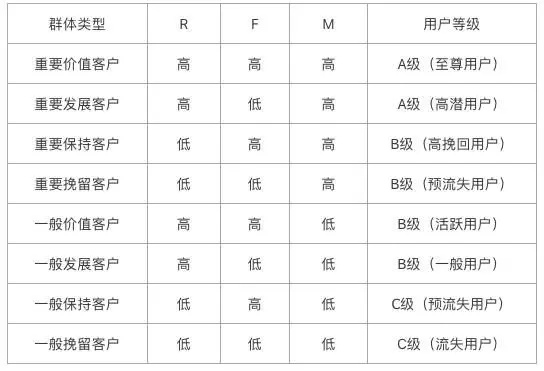

如果你听过客户关系管理(CRM),那么你大概率上也曾听到过RFM模型。在精细化运营的今天,在解决如何更好的挖掘用户价值之前,首先要解决的问题是如何衡量用户价值? 和用户价值有关的模型非常多,除了RFM模型之外,还有客户生命周期价值模型(CLV模型)、客户生命周期模型(AARRR模型)等。不同的模型切入的角度以及具体的应用不同,我们今天主要讲的是RFM模型。 本文主要分为两个部分:一是理论部分,简单告诉大家RFM模型是什么?能够给生意带来什么帮助?二是计算部分,如何只用EXCEL就可以计算RFM值并得出用户分层数据。 根据美国数据库营销研究所Arthur Hughes教授的研究表明,在客户的数据库中有三个要素,这三个要素构成了分析用户价值的重要指标:R (Recency) : 最近一次交易时间间隔;F(Frequency) : 消费频率;M(Monetary): 消费金额。RFM模型即是这三个单词的首字母组合。

RFM模型的应用场景:针对重要价值客户。即RFM值均高的用户,我们通常称之为“至尊用户”,也是整个品牌用户群体中金字塔顶端的那一拨人,购买频率高,金额贡献高,而且频繁光顾店铺。针对这波用户,运营的主要策略是:保持稳定增长,“至尊用户”的数量不要出现流失,并且能够不断从下层用户中往上输送新的“至尊用户”。 针对重要挽留用户。即很久没有进行复购,但之前的购物金额以及购物频率都很高的用户,如果放任不管,这波用户很可能随着时间的流逝而流失。运营的主要策略是复购,可通过发放专属权益、针对性折扣、赠品等一系列的定向优惠形式使得这波用户重新光临店铺,对比拉新的成本,重新让这波用户再次回购的成本要低的多了。 针对一般价值客户。即RF值高但是M值小的用户,比较活跃但是成交金额比较低的用户。一般这类用户我们会称之为活跃用户,而且价格敏感型居多。运营的主要策略是针对这波用户提高他们的客单价,可以通过定向搭配购、加钱换购等形式不断提高该波用户的客单价,商品购物篮推荐也是非常有用的。 数据源准备:在开始之前我们需要准备好分析用的源始数据。我们利用交易数据可以提取到我们需要的RFM数据,利用简单的IF函数和数据透视表就可以实现了。

数据计算方法:方法一:四分位数法。方法二:评分法。这里介绍的两种方法是只要通过EXCEL的形式就可以计算出来的,针对规模较小,或者是没有数据分析部的公司。 而一般情况下,构建RFM模型常用的是K-means聚类算法来进行人群RFM值的定义与划分,但是K-means对于运营人员来说有些吃力了,多是数据分析工程师具备的技能了。

-

企业服务类产品的底层逻辑发布在 极客生涯

C端产品是面向终端用户或消费者的产品,往往承担引流和转化的任务,所以C端产品是企业与消费者之间的重要媒介,也是企业重要的获客手段之一;C端产品的用户表达需求,往往比B端产品的用户表达更精准或者说更明确,人人都可能是C端产品的用户,而B端产品却不是个体的使用决策,是集体使用体验。 做B端产品,我们围绕着用户核心的需求,专注极致。与其说用户在选择我们,其实因为资源有限,我们也在选择用户,不是所有功能我们都能做 ,最终只能在一个维度里解决最“痛”的点。 做减法比做加法更需要策略与克制,无论to B产品还是to C产品,最终的解决方案都应该是最简单的极致体现,以最短路径和最低资源成本满足用户的需求。 B端产品经理接受需求的来源要比C端产品丰富而复杂,对于B端产品经理,梳理需求的优先级开发排序是一件“左右逢源”的难事,要考虑服务部门的情绪,要照顾业务部的指标担当,还要兼顾公司市场拓展的进度。 有些需求是老板给的政治任务,有些需求是销售部提的,有些需求是为了支持运营活动的,有些需求是为了减轻客服团队重复答疑工作量的,以上种种都是产品需求来源的内部渠道,需求还包括用户使用后的反馈、行业技术进步等等,对于产品经理而言,学会将需求合理的排期是一门硬核技能。 对于咱们做B端产品的同学来说,得有系统的基础建设意识,包含业务梳理、个性化需求评审、产品架构设计等流程。企业服务类产品,在设计时要考虑能覆盖全场景、完整业务链路的闭环,因为任何一个环节的缺失和不完善,都会导致客户的业务流程无法正常运转。 影响产品成功的关键因素,除了创始团队对特定市场的深刻理解与前瞻预见之外,还有团队对资源的掌控调用能力。产品经理要深入了解行业,了解行业后才可能从全局视角看产品功能规划,先有了产品结构的骨骼,才慢慢长出肌肉和皮肤。 有效流量:用户痛点=需求程度需求频次。聊聊流量,建立在痛点满足基础上的流量才是有效流量。痛点=需求程度需求频次,有效的流量必然是极度需求且高频需求的。

-

思维不停,设计不败发布在 极客生涯

什么是思维定位呢?定位并不是一个职称,有人说自己的定位是一个设计师或自己的定位是一个小员工,自己的定位是一个搬砖的。以上这些都不是定位,定位应该是和你的工作相关且能够清晰描述出你要做什么的描述性文字。 为什么需要有定位思维呢? 明确定位可以使一个人知道自己需要做什么事情,知道自己不能做什么事情,确定自己的边界,可以使自己在自己的职责范围之内做事。当然此处说的边界是模糊的,边界离中心点越远,越模糊。这里说的边界并不是让大家固步自封,只做自己份内之事,其他的事莫不关系,而是告诉大家如何判断事情自己要做或不要做。 明确定位可以使自己知道什么是突破性的事情,每一位设计师做好自己的份内之事是最基础的,在团队中如果想更加突出或者更加有益,需要自己做突破性的事情,突破自己的能力边界,突破自己的认知边界,突破自己的价值边界。通过做事,帮助自己成长,提升自己的眼界,提升自己在团队中的价值。 其实定位思维中或多或少有一些关于目标的事情,“提升用户阅读体验的设计师”目标就是提升用户阅读体验,这里面还缺一点就是不够具体,目标一定是一个很具体的动宾短语,应该是提升某个场景或业务的阅读体验(只为举例)。 目标思维解决的根本性问题是人力、资源、时间管理的问题,目标思维可以让一个人专注与自己的目标,提升自己的工作效率,使自己或者团队各项资源得到最大价值的利用,并且产生最大的效能,可以避免忙碌了半年才发现自己啥也没干成,只是搬砖搬了一年,最后只能叹息为啥别人很优秀。 相信每一个人都想安安静静的把自己的工作做好,甚至有很多设计师说我就想好好的画图,其他的事不想做,但现实不是这样的。因为即使是平常的生活也会遇到不同的问题。 全局把控是指每一个人都需要把控好自己制定目标的完成过程,整个过程中会掺杂着各种各样的情况,所以我们每一个人都需要在做每一件事之前思考决定一项任务的三个最重要的变量,抓住3个变量,时刻关注进展和情况,并根据变化做好资源在3个变量上的调整,使资源得到最大的利用。为什么是3个呢?因为人的精力有有限的,同时越重要的变量对一个项目的影响也会越大,反之越小。 时间把控是一个计划制定的一部分,大家肯定听说过时间管理等等相关的内容,但大家可以想一想自己对于自己的项目或任务时间控制的很好吗?人天性都是懒惰的,为了减少懒惰对项目的影响,在完成项目之前一定要制定完整的计划,并做好时间的配比,关注重要节点事情的完成情况,非必要不增加时间或使项目延迟。 风险管理又分为风险的预见性和问题解决机制。每一个人需要具备风险的预先性,需要每一个人从项目的多个维度进行全面而完整的思考,如果想要从全局把握好一个项目的进度,则需要大家从人力、时间、协作、流程等方面对项目进行延伸性的思考,就是指大家要有预见性。 链接思维:心理学研究表明在团队协作中,大家都愿意和自己有过正向连接的人合作或者信任的人合作。

-

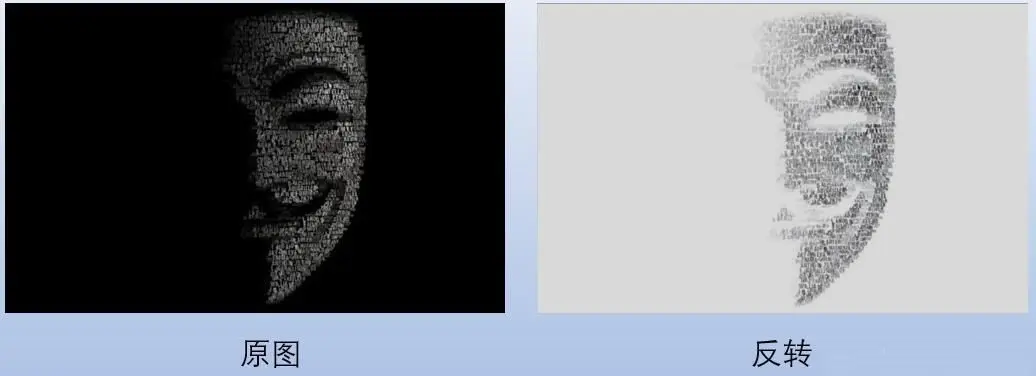

灰度变换与空间滤波发布在 极客生涯

图像在成像、采集、传输、处理等过程中不可避免的会造成某些降质。说白了就是图像可能会不清晰,采集中未突出所需部分,例如有噪音、散斑、运动模糊等等。所以我们要进行图像增强,达到我们想要的,最清晰的效果。图像增强是指对图像的某些特征如边缘、轮廓、对比度等进行强调。今天所说的灰度变换和空间滤波正是图像增强的两种方法。 灰度变换主要针对独立的像素点进行处理,通过改变原始图像数据所占据的灰度范围而使图像在视觉上得到良好的改变。所以他属于点处理。

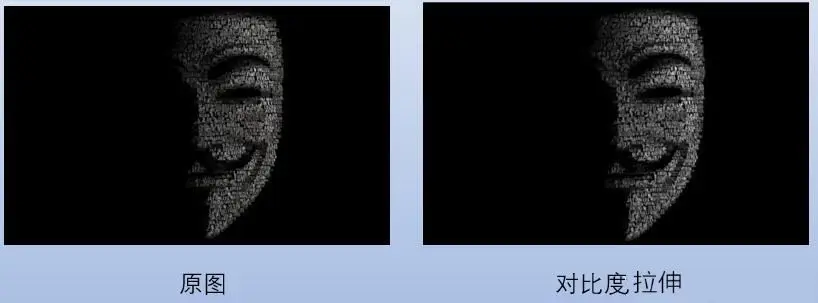

对比度拉伸。图像对比度指的是一幅图像中明暗区域最亮的白和最暗的黑之间不同亮度层级的测量,即指一幅图像灰度反差的大小。一般来说对比度越大,图像越清晰醒目,色彩也越鲜明艳丽;而对比度小,则会让整个画面都灰蒙蒙的。

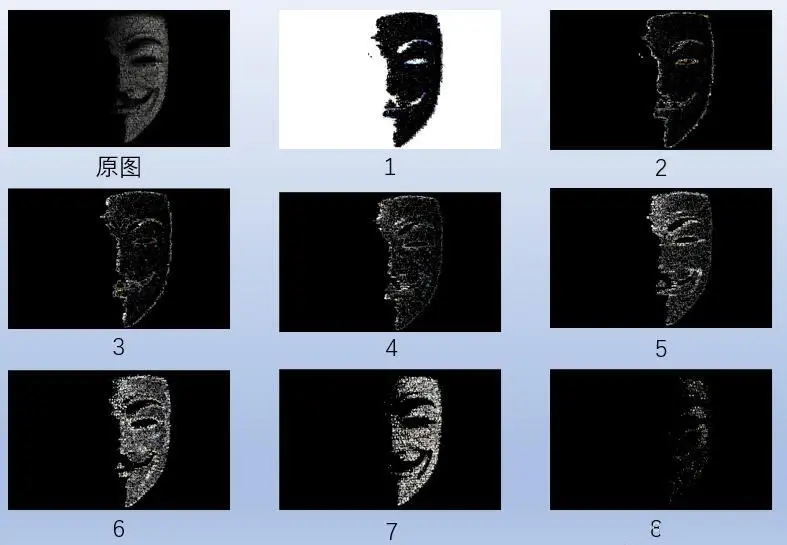

对比度拉伸。图像对比度指的是一幅图像中明暗区域最亮的白和最暗的黑之间不同亮度层级的测量,即指一幅图像灰度反差的大小。一般来说对比度越大,图像越清晰醒目,色彩也越鲜明艳丽;而对比度小,则会让整个画面都灰蒙蒙的。 比特分割。在灰度图中,像素值的范围为[0, 255],即共有256级灰度。在计算机中,我们使用8比特数来表示每一个像素值。因此可以提取出不同比特层面的灰度图。比特层面分层可用于图片压缩。如使用高四位比特层表示原有的八层比特平面。

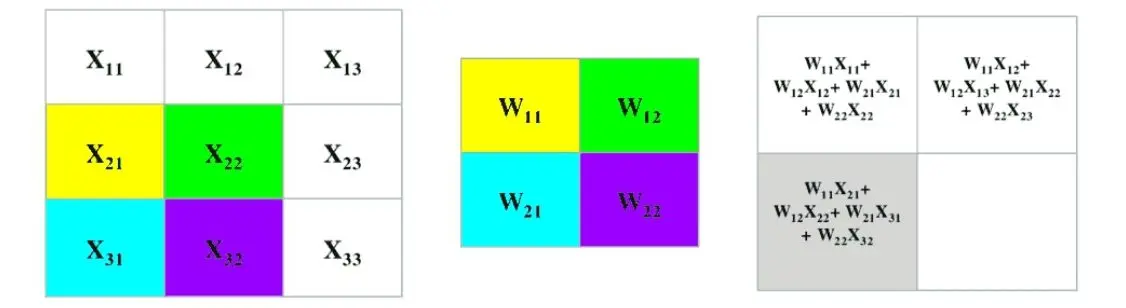

比特分割。在灰度图中,像素值的范围为[0, 255],即共有256级灰度。在计算机中,我们使用8比特数来表示每一个像素值。因此可以提取出不同比特层面的灰度图。比特层面分层可用于图片压缩。如使用高四位比特层表示原有的八层比特平面。 空间滤波就是直接在灰度值上,做一些滤波操作。滤波是图像处理中常用的技术,可以锐化图像、模糊图像、去除噪声、增强图像等等。简单来说,就是用一个n×n的矩阵扣在图像上,用模板中每一个元素对扣住的范围中对应的像素进行数学操作,将产生的数值赋给模板中心点所对应。

空间滤波就是直接在灰度值上,做一些滤波操作。滤波是图像处理中常用的技术,可以锐化图像、模糊图像、去除噪声、增强图像等等。简单来说,就是用一个n×n的矩阵扣在图像上,用模板中每一个元素对扣住的范围中对应的像素进行数学操作,将产生的数值赋给模板中心点所对应。 灰度变换和空间滤波都是图像增强的一种手段,且都是在空间域中操作的。空间域处理主要分为灰度变换与空间滤波两类,灰度变换在图像的单个像素上操作,主要以对比度和阈值处理为目的。空间滤波涉及改善性能的操作,如通过图像中每一个像素的领域处理来锐化图像。

灰度变换和空间滤波都是图像增强的一种手段,且都是在空间域中操作的。空间域处理主要分为灰度变换与空间滤波两类,灰度变换在图像的单个像素上操作,主要以对比度和阈值处理为目的。空间滤波涉及改善性能的操作,如通过图像中每一个像素的领域处理来锐化图像。 -

Google Play ASO优化发布在 极客生涯

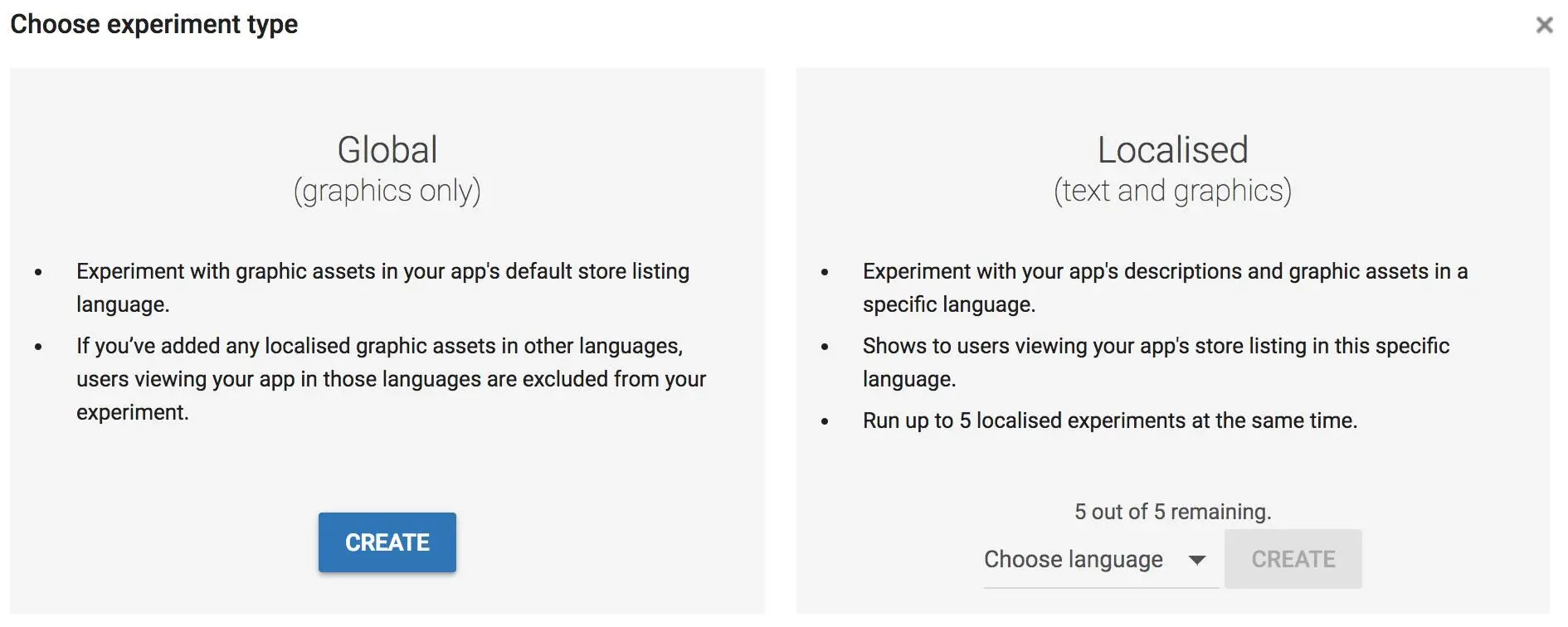

Google Play ASO优化:ASO优化分为两部分,on-metadata和off-metadata,on-metadata的因素完全由我们控制,而off-metadata包含一些我们无法控制的因素,但我们仍可以去影响这些因素。 on-metadata ASO:针对Google Play,相关因素有Title、Short description、Long description、Icon、Screenshots & Video、崩溃率。另外,需要特别注意的是,Google Play搜索的关键词权重排序为:Title > Short description > Long description。

-

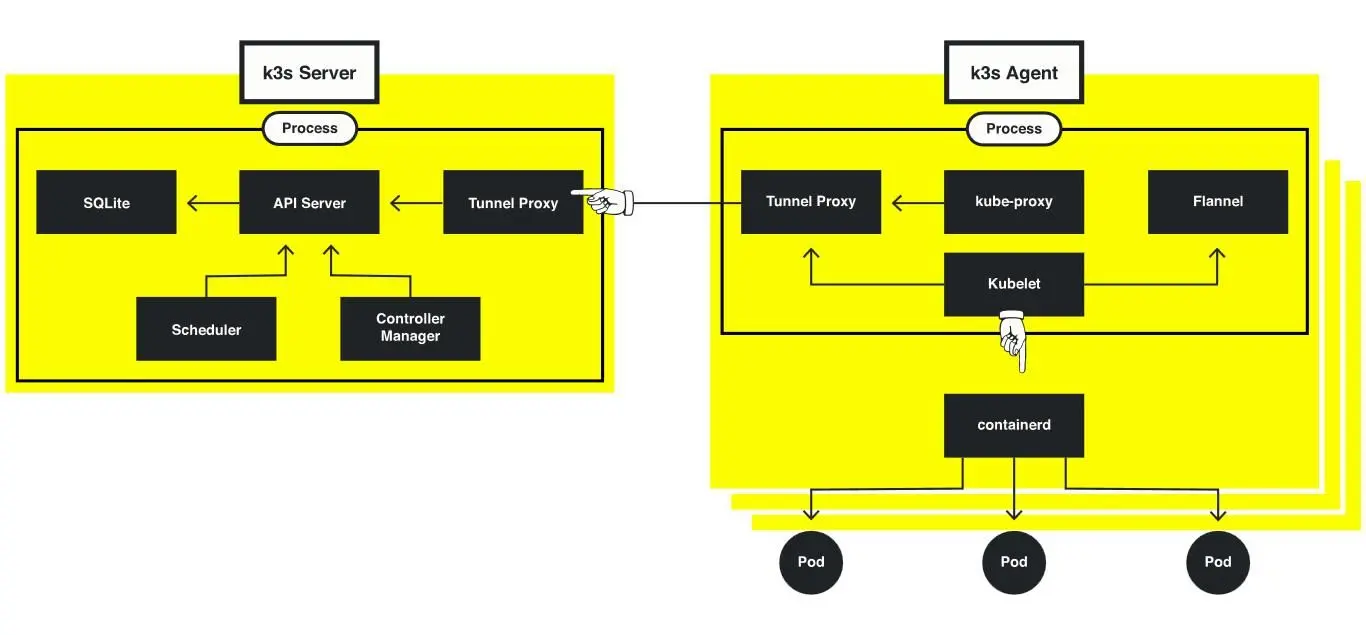

#轻量级Kubernetesk3s发布在 开源推荐

k3s 是一个轻量级 Kubernetes,它易于安装,二进制文件包小于 40 mb,只需要 512MB RAM 即可运行。

k3s 旨在成为完全兼容的 Kubernetes 发行版,相比 k8s 主要更改如下:旧的、Alpha 版本的、非默认功能都已经删除。删除了大多数内部云提供商和存储插件,可以用插件替换。新增 SQLite3 作为默认存储机制,etcd3 仍然有效,但是不再是默认项。封装在简单的启动器中,可以处理大量 LTS 复杂性和选项。最小化到没有操作系统依赖,只需要一个内核和 cgroup 挂载。

K3s是一个完全符合一致性生产就绪的Kubernetes发行版,有以下变化:打包为单个二进制文件;添加了对sqlite3的支持,作为默认存储后端。还支持Etcd3、MySQL和Postgres;将Kubernetes和其他组件包装在一个简单的启动程序中;默认情况下,它是安全的,对于轻量级环境来说是合理的;对操作系统的依赖最小,甚至不依赖(只需要一个健全的内核和cgroup挂载);通过通过websocket隧道将这个API暴露给Kubernetes控制平面节点,消除了为kubelet API暴露Kubernetes工作节点上的端口的需要。

-

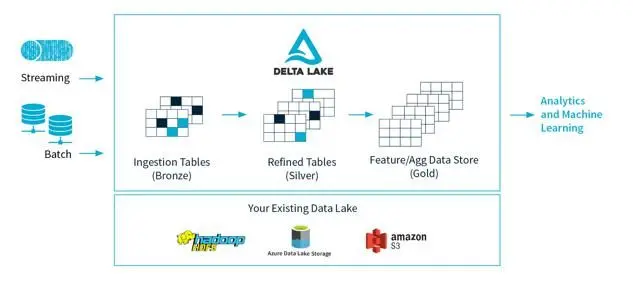

用于大数据的存储层DeltaLake发布在 开源推荐

Delta Lake 是一个存储层,为 Apache Spark 和大数据 workloads 提供 ACID 事务能力,其通过写和快照隔离之间的乐观并发控制(optimistic concurrency control),在写入数据期间提供一致性的读取,从而为构建在 HDFS 和云存储上的数据湖(data lakes)带来可靠性。

Delta Lake 在多并发写入之间提供 ACID 事务保证。每次写入都是一个事务,并且在事务日志中记录了写入的序列顺序。事务日志跟踪文件级别的写入并使用乐观并发控制,这非常适合数据湖,因为多次写入/修改相同的文件很少发生。在存在冲突的情况下,Delta Lake 会抛出并发修改异常以便用户能够处理它们并重试其作业。Delta Lake 还提供强大的可序列化隔离级别,允许工程师持续写入目录或表,并允许消费者继续从同一目录或表中读取。读者将看到阅读开始时存在的最新快照。

模式管理(Schema management):Delta Lake 自动验证正在被写的 DataFrame 模式是否与表的模式兼容。表中存在但不在 DataFrame 中的列设置为 null。如果 DataFrame 有表中不存在的列,则此操作会引发异常。Delta Lake 具有显式添加新列的 DDL 以及自动更新模式的能力。

可扩展元数据处理:Delta Lake 将表或目录的元数据信息存储在事务日志中,而不是 Metastore 中。这允许 Delta Lake 在恒定时间内列出大型目录中的文件,同时在读取数据时非常高效。

数据版本:Delta Lake 允许用户读取表或目录之前的快照。当文件被修改文件时,Delta Lake 会创建较新版本的文件并保留旧版本的文件。当用户想要读取旧版本的表或目录时,他们可以在 Apache Spark 的读取 API 中提供时间戳或版本号,Delta Lake 根据事务日志中的信息构建该时间戳或版本的完整快照。这允许用户重现之前的数据,并在需要时将表还原为旧版本的数据。

统一流和批处理 Sin:除批量写入外,Delta Lake 还可用作 Apache Spark structured streaming 的高效流式 sink。结合 ACID 事务和可扩展的元数据处理,高效的流式 sink 现在可以实现大量近实时分析用例,而无需同时维护复杂的流式传输和批处理管道。

数据存储格式采用开源的:Delta Lake 中的所有数据都是使用 Apache Parquet 格式存储,使 Delta Lake 能够利用 Parquet 原生的高效压缩和编码方案。

项目地址: https://github.com/delta-io/delta -

为Kubernetes提供CI/CD服务JenkinsX发布在 开源推荐

Jenkins X 是一个高度集成化的 CI/CD 平台,基于 Jenkins 和 Kubernetes 实现,旨在解决微服务体系架构下的云原生应用的持续交付的问题,简化整个云原生应用的开发、运行和部署过程。

它依然使用 Jenkins 作为持续交付的核心引擎,实际上 Jenkins X 作为 Jenkins 的一个子项目存在,专注于云原生应用的 CI/CD 实现,同时也帮助 Jenkins 自身完成云原生应用的转型,毕竟现在越来越多的人在诟病单体应用的设计和文件存储系统。

Helm 是用于管理 Kubernetes 资源对象的工具,类似 APT,YUM 和 HOMEBREW,它通过将 Kubernetes 的资源对象打包成 Chart 的形式,完成复杂应用的部署和版本控制,是目前业界流行的解决方案

Draft 是自动化应用构建和运行在 Kubernetes 上面的工具,具有语言识别能力,能够自动生成构建脚本,依赖,环境并打包成 Docker 镜像并部署在 Kubernetes 集群上,加快代码开发节奏,而无需关心基础设施层面的技术实现。

GitOps 是 Weaveworks 推出的天才的应用部署解决方案,它将 Git 作为整个应用部署的单一可信数据源(SSOT),通过类似代码开发的 Pull Request 流程完成应用部署的 Review 和自动化实现,并且将部署配置信息纳入版本控制。

项目地址: https://github.com/jenkins-x/jx

-

归纳法、工业化与人格权发布在 极客生涯

随着互联网的不断发展,人工智能也开始普及,特别是如今在很多产品中,都会用到“算法”的方式进行推送,持续提升用户的依赖度与变现效率。 机器(推荐算法)的优势,通俗来说是一个归纳的过程,它获得一万个经验点可以归纳出一个结论;人是一个演绎的过程,小孩子看到一只猫就可以知道世界上所有的猫,但机器不可能只给它一只猫的照片,它就能知道所有的猫。你要给它十万张猫的照片,它才可能识别出十万零一只猫的照片。 这在认知上其实是不同的,机器还没有到达演绎的能力;演绎就是设计,我们根据自己积累的很少的样本,就可以去推理出新的东西,这是两个事情。我觉得,只有在内容推荐领域,才可以说这个能交给算法,在所有的非内容推荐的领域,还是需要靠人去做的。 关于归纳法,卡尔·波普尔认为:“它既不能给人们以未来的必然性知识,也不能给人们以未来的或然性知识。”时至今日,归纳法在工业化应用之后,波普尔的前半句「必然性」一定程度得到了解决;但后半句或然性仍然是归纳法难以做到的。 当计算器可以快速将15*271的结果计算出来时,人就没必要抬杠再去和它比计算速度。人总是生产出来新工具,然后利用它们再去参与世界的活动,算法也是如此。 但由于机器算法缺少了想象、情感、联想的能力,使得人类能够借助「演绎法」,暂时保住世界之王的位置。在新的时代浪潮下,文化冲突与保守主义并没有因为技术进步而衰退,相反,它们卷土重来、愈演愈烈。 在这种权力的结构下,除了公众权利的保障存在风险,还有更加令人担忧的问题,即:“随着“归纳法(算法)工业化”不断发展,大量的分析决策更加自动化、效率更高,人类难以与机器在相关领域抗衡,致使其主动让渡了部分的「信息选择权、判断权」。 斯坦福教授Jeffrey Pfeffer在研究“权力”的课题时,他发现:如果你自己不放弃权力,别人要削弱你的权力会困难得多”,人类与机器的关系也是如此。拥有选择、决断的能力,是人之所以成为人的最基础要素。技术可以告诉你如果这么做会怎么样,但最后还是要交给人来做判断的,而判断的过程就显示出人的个性,如果这种判断都被剥夺的话,人就不是“人”了。 对这种困境的反思,就是人类使用演绎法保护自己的过程。